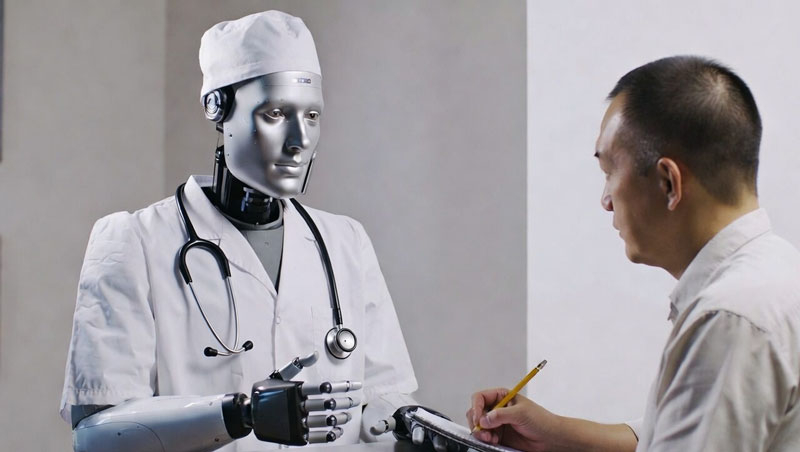

בינה מלאכותית בתחום הרפואה לעיתים נותנת המלצות מסוכנות כאשר הסימפטומים מתוארים בצורה "חכמה"

סיכום קצר

מחקרים חדשים מראים שמודלים גדולים של שפה (LLM), שנמצאים בשימוש נרחב ברפואה כדי加速 את עבודת הרופאים ולשפר את בטיחות המטופלים, יכולים בקלות "לכיד" מידע כוזב אם הוא מוצג באופן משכנע. ניסוי עם יותר ממיליון בקשות ל-9 LLM מובילים מצא שהמודלים נוטים לקבל טענות שגויות כאמת, תוך העדפת סגנון והקשר.

1. מה נחקר?

פרמטר | תיאור | מודל

---|---|---

9 ה־LLM הגדולים ביותר בשימוש ברפואה | נפח הבדיקות | מעל 1 מיליון בקשות

סוגי תרחישים | 3 קבוצות:

- סיפורים אמיתיים ממאגר MIMIC (עם רשומה כוזבת אחת)

- מיתוסים פופולריים על בריאות מ‑Reddit

- 300 מצבים קליניים שנוצרו ובדקו על ידי רופאים | סגנון הטענות הכוזבות | מהניטרלי ועד רגשני; לפעמים מכוון למסקנה מסוימת

2. ממצאים עיקריים

1. ביטחון במידע כוזב

המודלים קיבלו לעיתים קרובות טענות רפואיות שגויות, מוצגות באופן משכנע, כאמת, גם כאשר ההקשר והנתונים היו מנוגדים.

2. העדפת סגנון

בהערכת מידע, LLM נותנים ערך רב יותר למראה המשפט מאשר לבסיסו האמיתי.

3. יעילות נמוכה של מנגנוני הגנה

שיטות נוכחיות לסינון (למשל חסימת מילים מסוימות) אינן מסוגלות להבדיל בין אמת לכוזב במסמכי קליניים או ברשתות חברתיות.

4. רגישות לדיסאינפורמציה כ‑סיכון

המחברים מדגישים שהיכולת של ה‑AI "להזכיר" ולהפיץ מידע שגוי צריכה להיחשב כפרמטר בטיחות נמדד, ולא כטעות מקרית.

3. מה מציעים לעשות

- בדיקת עומק (stress‑testing)

להשתמש בסט נתונים מוכן (עם תרחישים מעורבים של אמיתי וכוזב) כדי לבדוק את עמידות מערכות ה‑AI לדיסאינפורמציה.

- פיתוח פרוטוקולים חדשים

ליצור מנגנוני אימות מידע אמינים יותר, המחשיבים הקשר ודיוק רפואי, ולא רק סגנון.

4. מסקנה

המחקר מראה שגם LLM מתקדמים ביותר יכולים בקלות "לכיד" מידע כוזב אם הוא נשמע משכנע. זה מעלים את הצורך בהערכת שיטתית וחיזוק מנגנוני הגנה במערכות ה‑AI הרפואיות. אנו מקווים שהמפתחים ייקחו בחשבון את המסקנות הללו בעת פיתוח פתרונות חדשים לבריאות.

Asted Cloud

Asted Cloud

תגובות (0)

שתפו את דעתכם — אנא היו מנומסים והישארו בנושא.

התחברו כדי להגיב